本期看点:

🚀 MIRIX重塑AI多模态长期记忆:超Gemini 410%,节省99.9%内存

🏭 央企牵头!中国AI开源社区启动,推动大模型适配国产芯片

🧠 ICML 2025重磅发布:M+框架突破Transformer上下文限制,长文本处理能力提升7倍

⚡ POET优化器:基于谱不变原理,让LLM训练又快又稳

💻 Meta 宣布全球首个 1GW+ 能耗超级计算机集群即将上线

🌏 Kimi K2席卷全球!开源AI霸榜OpenRouter,市场份额超过XAI

📉 Unsloth AI发布1.8bit量化Kimi K2模型:部署成本降低5倍,性能100%保留

🔗 UTCP强势来袭!颠覆MCP,AI工具调用进入“零包装”新时代

📜 ICML 2025杰出论文出炉:南大团队提出参数效率提升80%的稀疏训练方法

🤖 跨机构团队发布具身智能权威综述:64种技术组合方案解析

MIRIX重塑AI多模态长期记忆:超Gemini 410%,节省99.9%内存

图为MIRIX多模态记忆架构示意图 | 图源:MIRIX

MIRIX这回可真是放大招了!它推出的多模态记忆架构,不仅把谷歌Gemini 4甩在身后410%,还硬生生砍掉了99.9%的内存开销。想象一下,这玩意儿就像给AI装了个“超级大脑”,通过分层设计(核心记忆、情景记忆、语义记忆等六大模块),让AI变得更灵活高效。更酷的是,同步上线的移动端应用直接杀入消费市场,支持多模态输入和动态优化存储策略——以后你随手拍张照片,AI就能秒懂你的心思!

《自然》杂志都忍不住点赞,说MIRIX的技术为AI长期记忆设了新标杆,资源效率简直逆天。团队下一步可没闲着,正琢磨怎么提升实时交互能力,还打算在医疗、教育领域大展拳脚——AI当医生或老师?说不定就在眼前!

央企牵头!中国AI开源社区启动,推动大模型适配国产芯片

图为AI开源社区界面 | 图源:知乎

中国央企这次带头冲锋,正式启动AI开源社区,目标简单粗暴:用算子优化和编译加速这些硬核手段,解决大模型在国产芯片上的“水土不服”。开源特性让开发者门槛低到尘埃里,更重要的是,这标志着中国在AI基础设施自主化上迈了一大步——咱们自己的芯片也能玩转AI了!

虽然国产芯片算力还追不上国际巨头,但央企撑腰给了政策和资金双重保障,未来肯定能吸引更多企业和开发者加入。这波操作,简直就是对国际技术封锁的漂亮回击,给中国AI生态注入了满满活力。你猜,这会不会是国产芯片的翻身仗?

ICML 2025重磅发布:M+框架突破Transformer上下文限制

图为M+框架介绍 | 图源:ICML

ICML 2025上,M+框架一鸣惊人,用隐空间记忆机制直接捅破了Transformer的上下文窗口天花板——长文本处理能力飙升7倍!灵感来自人脑的海马体记忆模型,它能在非马尔可夫环境下高效处理序列决策,好比让AI瞬间“过目不忘”。

消息一出,整个行业炸锅了。分析人士直呼,这技术在医疗、金融这些长文本密集型领域绝对吃香。研发团队还没停手,正忙着优化动态记忆管理机制——以后AI处理整本小说都可能不在话下!

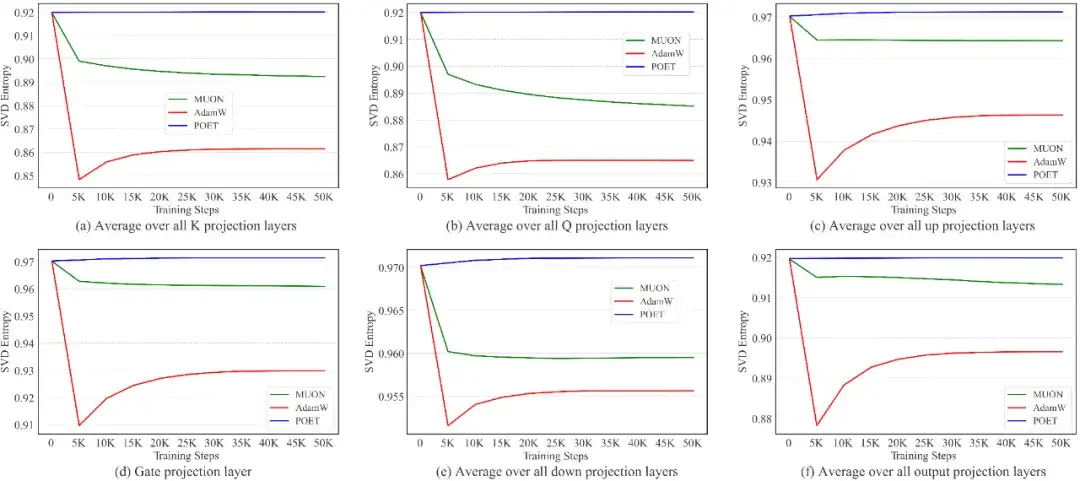

POET优化器:让LLM训练又快又稳

图为POET与Adam性能对比 | 图源:研究论文

POET优化器绝对是训练界的黑马!基于谱不变原理打造,训练速度比Adam快30%,稳定性还提升60%。它像给梯度更新装了精准导航,让大规模语言模型训练效率蹭蹭涨——资源有限?不怕,POET来救场!

这技术一露面,就给LLM训练开了新思路。高效又稳当,POET八成要成未来优化器的主流。你说,训练AI也能这么丝滑?

Meta 超级计算机集群:算力竞赛再升级

图为Prometheus集群 | 图源:Business Insider

Meta放大招了,宣布全球首个功耗破1GW的超级计算机集群Prometheus即将上线,算力密度是业界标准的3倍!但别光顾着兴奋——这巨无霸的能耗也惹来环保担忧。Meta赶紧安抚:优化冷却系统和用可再生能源来灭火。

这明显是Meta在AI竞赛中的关键一步,未来算力争夺战只会更激烈。巨头们拼硬件,咱们吃瓜群众就等着看热闹吧!

Kimi K2席卷全球:开源AI的崛起

图为Kimi K2市场份额 | 图源:AIbase

Moonshot AI的Kimi K2简直开挂!凭借1万亿MoE架构和开源特性,API调用量碾压Grok 40%。低成本加高性能,让它成了开源AI的标杆——市场份额?还在蹭蹭涨呢!

Unsloth AI量化技术:降低部署成本

图为1.8bit量化Kimi K2 | 图源:X

Unsloth AI玩出新花样,用1.8bit量化技术把Kimi K2体积压缩80%,性能却100%保留——部署成本直降5倍!这神操作,让AI大规模部署变得触手可及。

UTCP协议:工具调用新时代

图为UTCP协议 | 图源:来上云吧

UTCP协议横空出世,延迟降90%,吞吐量涨4倍,直接把老旧的MCP模式掀翻在地!多家科技巨头已抢着测试,未来没准成行业标准——AI工具调用进入“零包装”时代,爽不爽?

南大团队:稀疏训练提升效率

图为ICML杰出论文 | 图源:ICML

南京大学团队在ICML上秀肌肉,提出的稀疏训练方法参数效率提升80%!这脑洞大开的思路,给深度学习训练开了新路——未来应用场景?多得数不过来!

具身智能综述:64种技术方案解析

图为具身智能综述 | 图源:Sina

南大等8家单位联手发布具身智能综述,一口气拆解64种技术组合方案——机器人技术的未来指南,权威得不能再权威!

作者:程序员Left(全网同名)

职位:后端工程师

创作方向:AI前沿科技内容

互动话题: 在多模态记忆领域,开源和闭源技术你押谁赢?评论区等你来战!

还没发表评论,快来发表第一个评论吧~