本期看点:

🚀 Meta视觉基座DINOv3王者归来:自监督首次全面超越弱监督

💡 谷歌开源Gemma 3 270M,性能超越Qwen 2.5同级模型

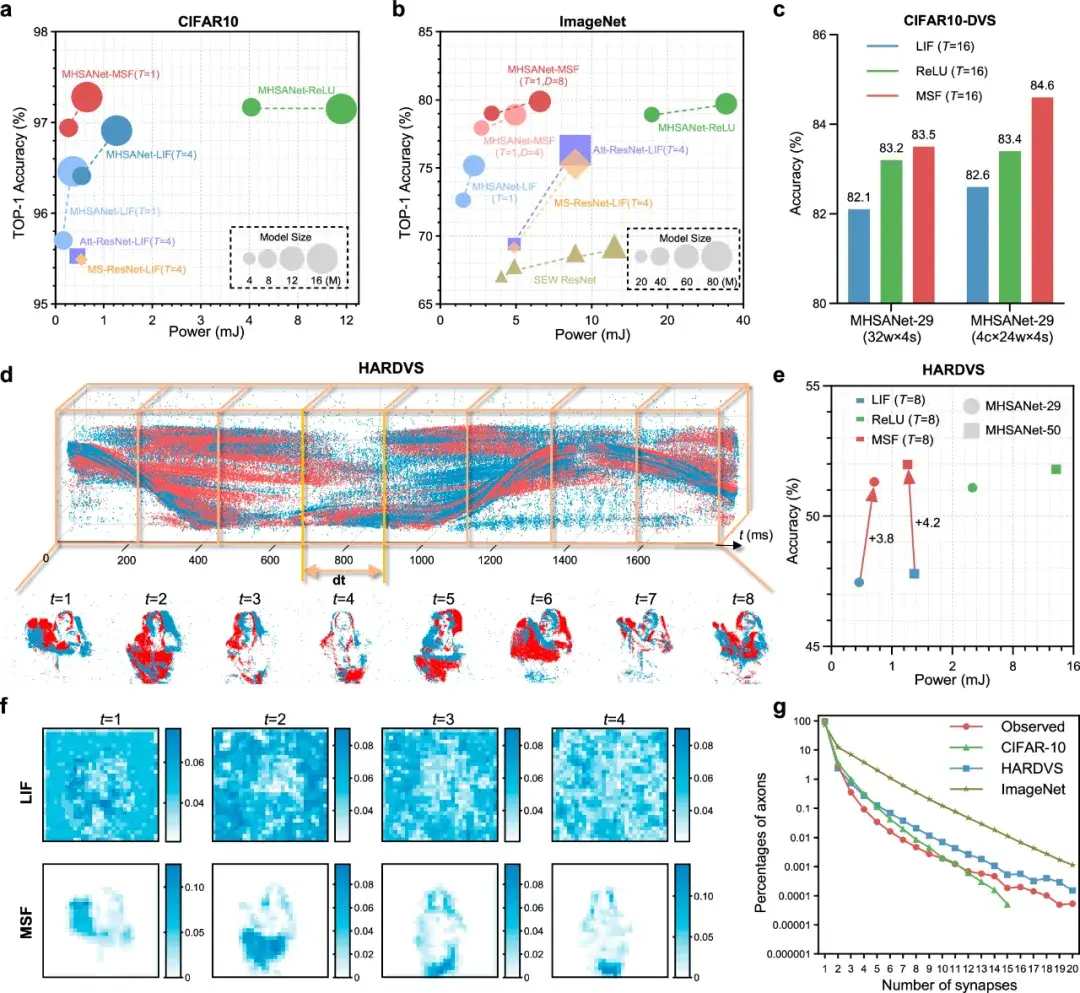

🧠 多突触神经元模型问世,国内团队打造类脑计算新引擎

🛠️ 欧洲AI独角兽发布超微型AI模型,突破物联网设备算力限制

☁️ 腾讯云推出AI开发工具CloudBase AI CLI,重构AI开发工作流

Meta视觉基座DINOv3王者归来:自监督首次全面超越弱监督

DINOv3架构图展示了其自监督学习的核心流程 | 图源:Meta AI

Meta AI这次可真是放大招了!DINOv3模型一出场,就打破了自监督学习(SSL)多年的瓶颈,第一次在性能上全面碾压了传统的弱监督学习。想象一下,标注成本瞬间砍掉90%,这不就是视觉AI界的超级英雄吗?靠着4.8亿参数的庞大身躯和12.7%的准确率飙升,它稳稳坐上视觉基座模型的王座。

最酷的是,DINOv3压根不需要人类费劲标注数据——它自个儿啃了1.7亿张图片,就练成了绝世神功。秘诀在哪儿?冻结主干架构和轻量适配器设计,让开发者用一点点标注数据就能部署高性能模型。NASA已经用它扫描火星地质了,医疗影像和自动驾驶领域也正热火朝天测试呢。

Meta这次大方极了,不仅开源了预训练模型,还附赠全套训练代码和评估工具。零售和制造业的小伙伴们,你们的好日子来了!

谷歌开源Gemma 3 270M:性能超越Qwen 2.5同级模型

图为Gemma 3与Qwen 2.5的性能对比 | 图源:Google DeepMind

谷歌又搞事情了!Gemma 3 270M这个小个子,才2.7亿参数,推理延迟低到300ms,内存占用才1.2GB,却把参数更大的Qwen 2.5模型甩在了身后。边缘设备们终于等来了救星,这简直是AI部署的迷你革命啊!

压缩技术和硬件适配优化是它的独门绝技,自然语言理解任务得分高出Qwen 2.5整整15%。你说,这会不会逼得其他厂商连夜加班开发轻量级模型?边缘计算的标准化浪潮,怕是挡不住了!

多突触神经元模型问世:国内团队打造类脑计算新引擎

图为多突触神经元模型示意图 | 图源:Nature Communications

中科院计算所的科学家们这回真给力!多突触神经元模型登上《自然·通讯》封面,模拟生物神经元的多突触特性,能效比猛增23倍,为脉冲神经网络(SNN)插上了硬件的翅膀。

动态调整神经元间的信息传递效率,让它能在低功耗下搞定复杂计算。自动驾驶和智能医疗的未来,是不是瞬间变得更酷了?想象一下,你的车和医生的设备都像大脑一样聪明!

欧洲AI独角兽发布超微型AI模型

图为Multiverse Computing发布的超微型AI模型 | 图源:Startup Ecosystem Canada

Multiverse Computing的超微型模型——SuperFly和ChickBrain,简直是为物联网设备量身定做的!SuperFly响应延迟低到15毫秒,内存不到1.5GB,9400万参数就能离线推理;ChickBrain虽大点,32亿参数也超高效。智能手表们终于能“聪明”起来了!

苹果和三星已经抢着合作了,物联网的本地智能时代,看来真要起飞了!

腾讯云推出AI开发工具CloudBase AI CLI

图为CloudBase AI CLI界面图 | 图源:腾讯云

腾讯云的CloudBase AI CLI来了,把代码生成和云开发环境打包送上,重复代码生成效率飙升80%。开发者朋友们,准备好解放双手了吗?

命令行一敲,代码哗哗生成,省下的时间够你喝杯咖啡了。未来还会支持更多语言和框架,生态一扩展,AI开发怕是要改头换面啦!

作者:程序员Left(全网同名)

职位:后端工程师

创作方向:AI前沿科技内容

本期讨论:轻量级AI模型会统治边缘计算吗? 来评论区,说说你的高见!

还没发表评论,快来发表第一个评论吧~